O PC gamer sempre quis ter a melhor imagem possível, rodando na resolução nativa do monitor. Fazer upscaling era sinônimo de imagem borrada, perda de qualidade e um "jeitinho" para quem não tinha hardware potente o suficiente. O hardware e tecnologia evoluíram a um ponto que fez muitos repensarem novamente essa premissa máxima e velha.

- O que é Mega Geometry e por que a NVIDIA aposta tanto nela

- O que o DLSS 5 faz de tão diferente e por que ele parece tão controverso

Um teste cego do portal ComputerBase, que contou com quase 7 mil votos da comunidade, deixou isso bem claro. Em títulos extremamente exigentes como Cyberpunk 2077 e Horizon Forbidden West, os jogadores escolheram cegamente o DLSS 4.5 da NVIDIA como a melhor imagem disponível, derrotando o outrora soberano 4K nativo. A percepção humana finalmente admitiu que a reconstrução inteligente superou a força bruta.

A grande questão que fica no ar é quase filosófica para os entusiastas: como uma imagem que é renderizada internamente em 1440p e depois esticada para 4K consegue exibir mais detalhes do que uma imagem gerada puramente na resolução máxima? A resposta para esse fenômeno não é mágica, mas sim um refinamento extremo de matemática aplicada e Inteligência Artificial.

-

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

-

Problema do nativo: o vilão TAA

Para entender o sucesso do DLSS, precisamos primeiro compreender as falhas inerentes ao método tradicional de renderização. Na busca pela fidelidade na resolução nativa, os jogos modernos utilizam quase obrigatoriamente o TAA, ou Temporal Anti-Aliasing, para remover o serrilhado das bordas dos objetos. Sem ele, a imagem pareceria cintilar e as linhas diagonais seriam escadarias de pixels.

O grande defeito é que o TAA funciona misturando informações de quadros anteriores com o quadro atual para suavizar a imagem. Esse processo gera um efeito colateral de borrão persistente na tela, especialmente perceptível quando a câmera se move rapidamente.

Detalhes finos e de alta frequência, como fios de cabelo, grades de cercas distantes e as folhas individuais de árvores, acabam virando uma massa indefinida e cinzenta. Na prática, o 4K nativo que tanto defendemos é, na verdade, um 4K borrado e suavizado excessivamente pelo TAA, o que joga fora boa parte da nitidez que a resolução deveria entregar.

O segredo da NVIDIA: núcleos Tensores e sua magia

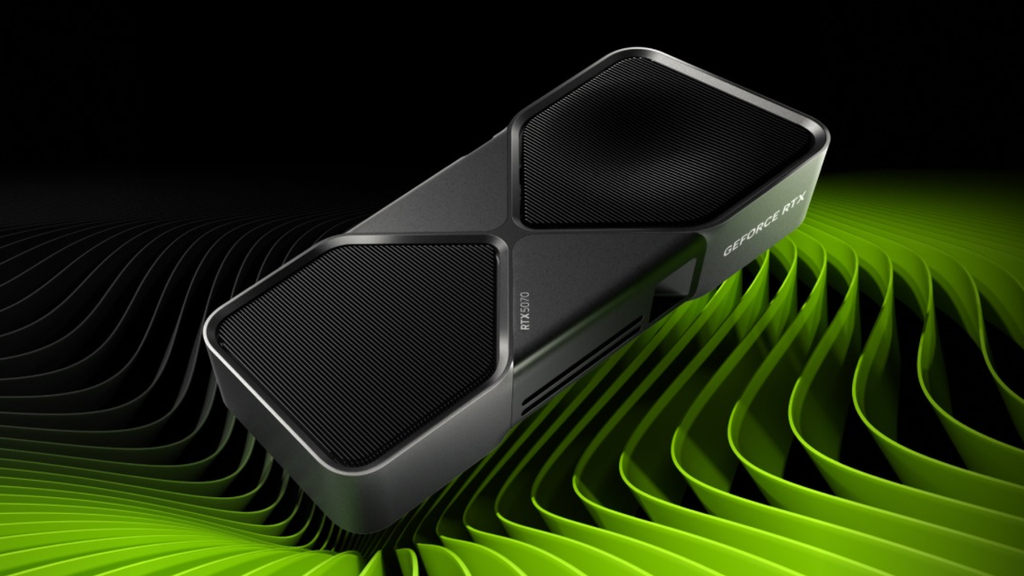

Diferente do FSR da AMD (com exceção do FSR 4 e as RX 9000), a NVIDIA apostou em um caminho de hardware dedicado. Dentro das placas RTX, existem unidades de processamento específicas chamadas Tensor Cores, que são os verdadeiros cérebros por trás da operação. Enquanto a GPU tradicional desenha os polígonos, esses núcleos cuidam exclusivamente da inteligência da imagem.

O algoritmo do DLSS passa por um treinamento intenso nos supercomputadores da NVIDIA usando imagens em resoluções absurdas, como 16K. Isso cria uma base de conhecimento onde a IA aprende como cada objeto deveria ser representado com alta fidelidade.

Quando você joga em 1440p, a rede neural da sua placa de vídeo já sabe como aquela imagem deveria se parecer se estivesse em 4K. Ela não apenas estica os pixels existentes, mas recria de forma precisa os detalhes que o motor do jogo não renderizou, eliminando o rastro deixado pelo TAA e entregando uma nitidez que o método nativo simplesmente não consegue alcançar.

Ray Reconstruction: maior fidelidade gráfica

O salto definitivo para que a reconstrução de imagem batesse o nativo de forma indiscutível veio com a introdução da Reconstrução de Raios, ou Ray Reconstruction. Em jogos que utilizam Ray/Path Tracing pesado, calcular cada feixe de luz em tempo real exige um poder computacional que nem mesmo as GPUs mais caras possuem. Isso gera muito ruído visual, uma espécie de granulação que polui a imagem final, algo que a NVIDIA também trabalha para amenizar.

Para resolver isso, os desenvolvedores usavam denoisers tradicionais, que são filtros manuais que borram a luz para esconder o ruído, mas que também destruíam detalhes de reflexos e sombras. A IA do DLSS 4.5 substitui esses filtros arcaicos por uma rede neural treinada para entender o comportamento da luz.

O resultado impressiona: um reflexo em uma poça d'água ou o brilho em uma lataria de carro ficam drasticamente mais nítidos e estáveis do que no jogo original rodando de forma nativa. A tecnologia não está apenas redimensionando a imagem, ela está corrigindo a física da iluminação no processo.

DLAA: O "Modo deus" do anti-aliasing

Para aqueles usuários que possuem um hardware absurdamente potente, como RTX 5090, e não sentem necessidade de ganhar mais quadros por segundo, a NVIDIA oferece uma alternativa luxuosa chamada DLAA, ou Deep Learning Anti-Aliasing. Essencialmente, o DLAA utiliza a mesma IA e o mesmo cérebro neural do DLSS, mas sem reduzir a resolução de entrada. O jogo é processado em 4K e a IA trabalha em cima desse 4K nativo para limpar a imagem.

O resultado visual do DLAA é o que podemos chamar de a imagem definitiva. Ele aplica todo o conhecimento da rede neural para substituir completamente o TAA problemático, criando uma cena livre de serrilhados, sem nenhum rastro de borrão e com uma estabilidade temporal muito melhor. É a prova de que, mesmo quando temos poder de sobra para rodar tudo no máximo, a intervenção da IA ainda consegue entregar um refinamento que a renderização bruta, por si só, é incapaz de produzir.

Conclusão

O olho humano não se importa com a origem técnica do pixel, mas sim com o resultado que chega à retina. O teste cego provou que a IA consegue reconstruir elementos complexos, como cercas de arame e fios de poste, de forma muito mais estável e definida do que o motor gráfico do jogo conseguiria fazer sozinho, mesmo em resoluções altas.

Exigir o 4K nativo hoje em dia se tornou um preciosismo obsoleto que, na maioria das vezes, serve apenas para derreter a placa de vídeo e gastar energia sem um ganho visual proporcional. Ativar o DLSS, principalmente o 4.5 em uma RTX 50, não é mais um quebra-galho ou um sacrifício para ganhar performance, é obter a melhor fidelidade visual que a tecnologia moderna permite. E olha que quem está falando isso já foi amplamente contra, até experimentar de forma adequada.

Leia a matéria no Canaltech.