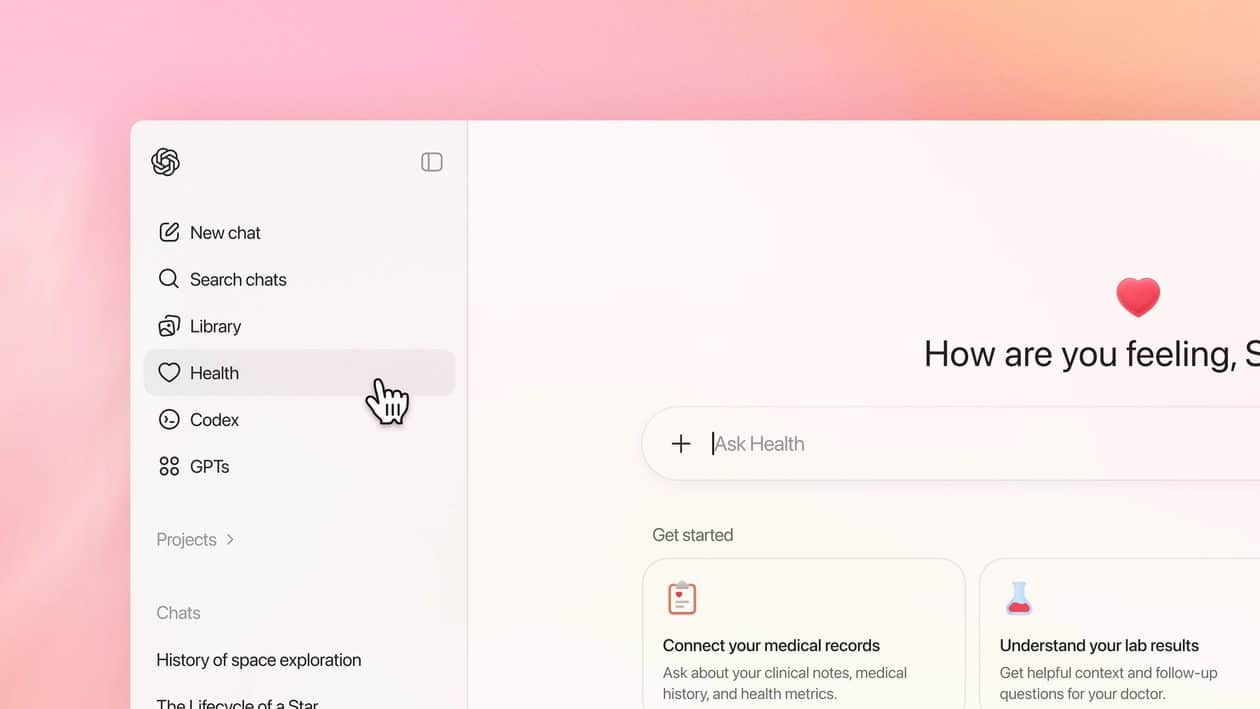

Ainda disponível apenas por meio de uma lista de espera, o recurso ChatGPT Health foi alvo de uma grande reportagem do The Washington Post com críticas sobre a sua eficácia para analisar dados de saúde dos usuários.

Assinada pelo repórter Geoffrey A. Fowler, a matéria mostra como o chatbot forneceu análises e insights extremamente equivocados após ele compartilhar seus dados do aplicativo Saúde (Health), da Apple.

Basicamente, o software da OpenAI lhe deu uma nota F (a mais baixa) quando o repórter pediu para avaliar sua saúde cardíaca — algo que um cardiologista ouvido pela reportagem disse não ter fundamento.

A IA tem um enorme potencial para destravar insights médicos e ampliar o acesso ao cuidado. Mas, quando se trata do seu rastreador de atividades e de alguns registros de saúde, o novo Dr. ChatGPT parece estar improvisando.

Segundo o repórter, muito da avaliação do ChatGPT se baseou na medição de VO₂ máximo do Apple Watch, que nada mais é que uma estimativa feita pelo relógio. A medição do valor real, por sua vez, exige testes laboratoriais com esteira e máscara respiratória.

A avaliação também deu muita ênfase à variabilidade da frequência cardíaca medida pelo relógio, que (segundo o especialista) é “imprecisa”, ignorando grandes oscilações que ocorreram sempre que o relógio foi trocado.

Posts relacionados

- OpenAI anuncia o ChatGPT Health, hub com suporte ao app Saúde da Apple

- ChatGPT Atlas agora suporta grupos de abas, substituições de texto do macOS e mais

- OpenAI testará anúncios no ChatGPT para usuários gratuitos e do plano Go, inicialmente nos EUA

Além disso, o chatbot por muitas vezes apresentou inconsistências nas respostas fornecidas, mudando suas recomendações e notas mesmo com base nos mesmos dados, ampliando a percepção de improviso.

É importante destacar que a matéria apresenta uma experiência individual e que pode ser diferente com outras pessoas — bem como também se atentar ao fato de que o recurso ainda está em fase de testes.

via 9to5Mac