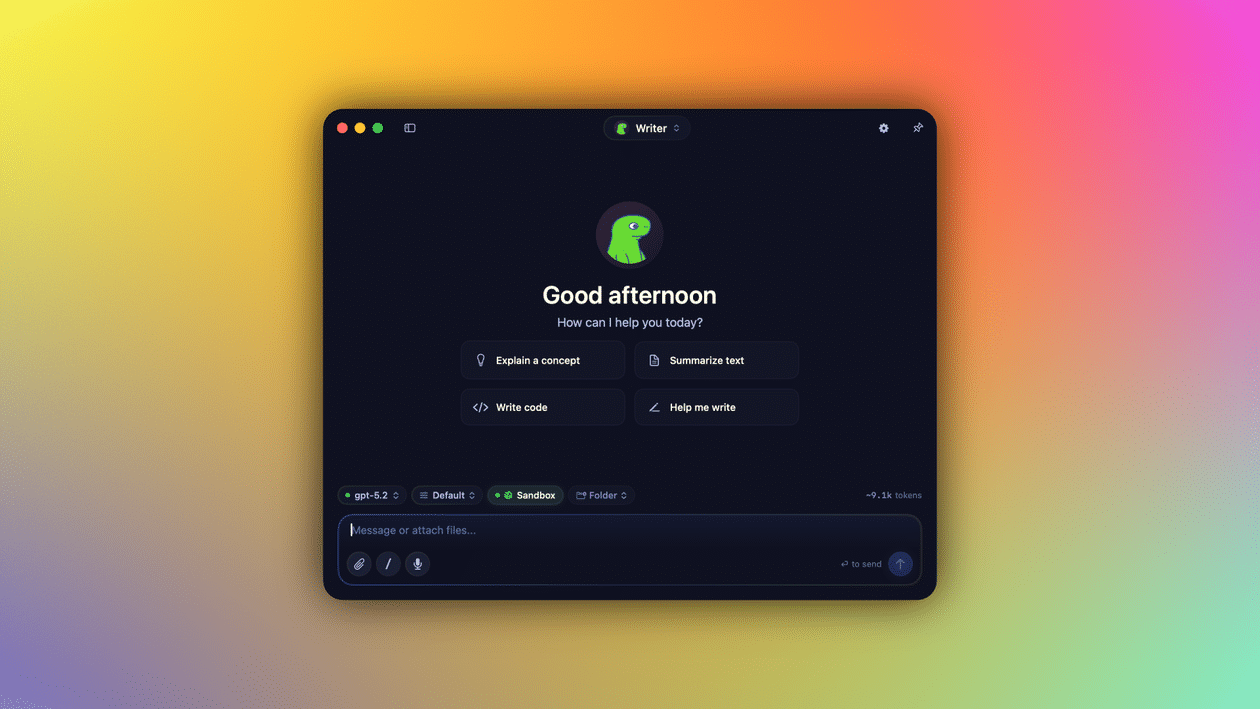

À primeira vista só mais um empreendimento de inteligência artificial (IA), o Osaurus é um servidor de LLM 1 de código aberto híbrido (isto é, que permite alternar entre modelos de IA locais e na nuvem, armazenando todos os seus arquivos na sua própria máquina) exclusivo do Mac.

Enquanto vários agentes de IA contam com uma abordagem mais centrada em públicos familiarizados com terminais e linhas de comando (não à toa, temos observado o crescimento das soluções com CLI), o Osaurus possui uma interface acessível ao consumidor comum, resolvendo dilemas mais complexos em uma sandbox virtual com isolamento por hardware, protegendo, assim, os dados do usuário.

Ao TechCrunch, o cofundador Terence Pae (ex-engenheiro de software da Tesla e da Netflix) relatou que a ideia surgiu a partir do feedback de alguns clientes sobre o assistente de IA criado por ele próprio, chamado Dinoki — o qual ele definiu como um “Clippy com IA” —, que questionavam o modelo de compra do app, dada a necessidade de aquisição de tokens.

O conceito era rodar um assistente local de IA:

Você pode fazer basicamente tudo no seu Mac localmente, como navegar pelos seus arquivos, acessar o seu navegador, acessar as configurações do seu sistema. Eu percebi que isso seria um jeito ótimo de posicionar o Osaurus como uma IA pessoal para indivíduos.

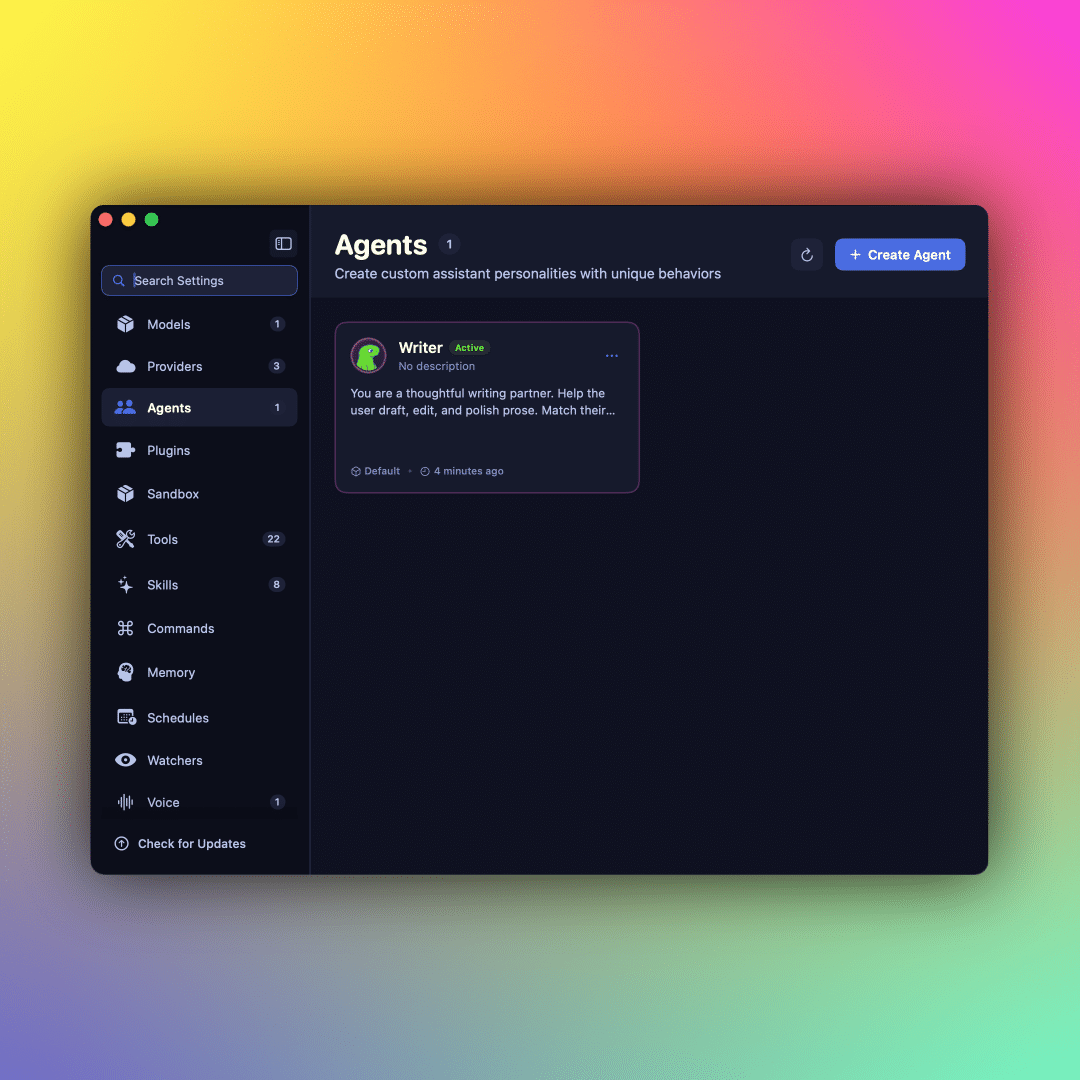

Usuários podem escolher se conectar tanto a modelos de IA hospedados no seu Mac quanto a provedores em nuvem (como a OpenAI e a Anthropic), selecionando quais modelos desejam utilizar enquanto preservam alguns elementos no próprio hardware (como a memória dos modelos, arquivos e ferramentas). O Osaurus é compatível com o DeepSeek v4, MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, etc.

A aposta de Pae em uma abordagem híbrida parece partir de uma consciência quanto às limitações da execução local de ferramentas de IA, embora pareça otimista com o futuro do segmento:

Eu consigo ver o potencial disso, porque a inteligência por watts, que é a métrica para IAs locais, cresceu significativamente. Tem a sua própria curva de inovação. Ano passado, IAs locais mal conseguiam terminar frases, mas hoje elas podem rodar ferramentas, escrever código, acessar o seu navegador e pedir coisas da Amazon […] está só melhorando.

Tratando-se de um servidor de MCP 2, ele é compatível com qualquer ferramenta que ofereça suporte ao protocolo, além de contar com mais de 20 plugins nativos para o Mail, o app Calendário (Calendar) e o Vision Pro. Ele também funciona com uso no macOS, planilhas, apresentações, navegador, pesquisa, arquivos do sistema, entre muitos outros.

Com os cofundadores Pae e Sam Yoo participando da startup Alliance de Nova York, os planos futuros em relação ao Osaurus incluem direcionar o serviço para setores como jurídico e saúde, onde o uso de LLMs locais poderá enfrentar a barreira da IA sobre privacidade.

Os dois acreditam que o aumento do interesse por IAs locais pode diminuir a demanda por data centers:

Em vez de depender da nuvem, você pode simplesmente instalar um Mac Studio on-premise, que deve consumir substancialmente menos energia. Você ainda terá as capacidades da nuvem, mas você não estará dependente de um data center para conseguir rodar essa IA.

O projeto já conta com mais de 110 mil downloads, de acordo com seu site oficial.