A OpenAI anunciou o ChatGPT Health, um espaço dedicado dentro do ChatGPT para conversas sobre saúde com proteções adicionais de privacidade e segurança. O diferencial central é arquitetural e de política: o ambiente opera em silo isolado com criptografia dedicada e as conversas ali não são usadas para treinar os modelos fundacionais da empresa.

A proposta é atender um comportamento já massivo na plataforma. Segundo a OpenAI, mais de 230 milhões de pessoas no mundo fazem perguntas semanais sobre saúde e bem-estar no ChatGPT, o que eleva o nível de responsabilidade sobre proteção de dados e risco de mau uso.

Entenda em 90 segundos

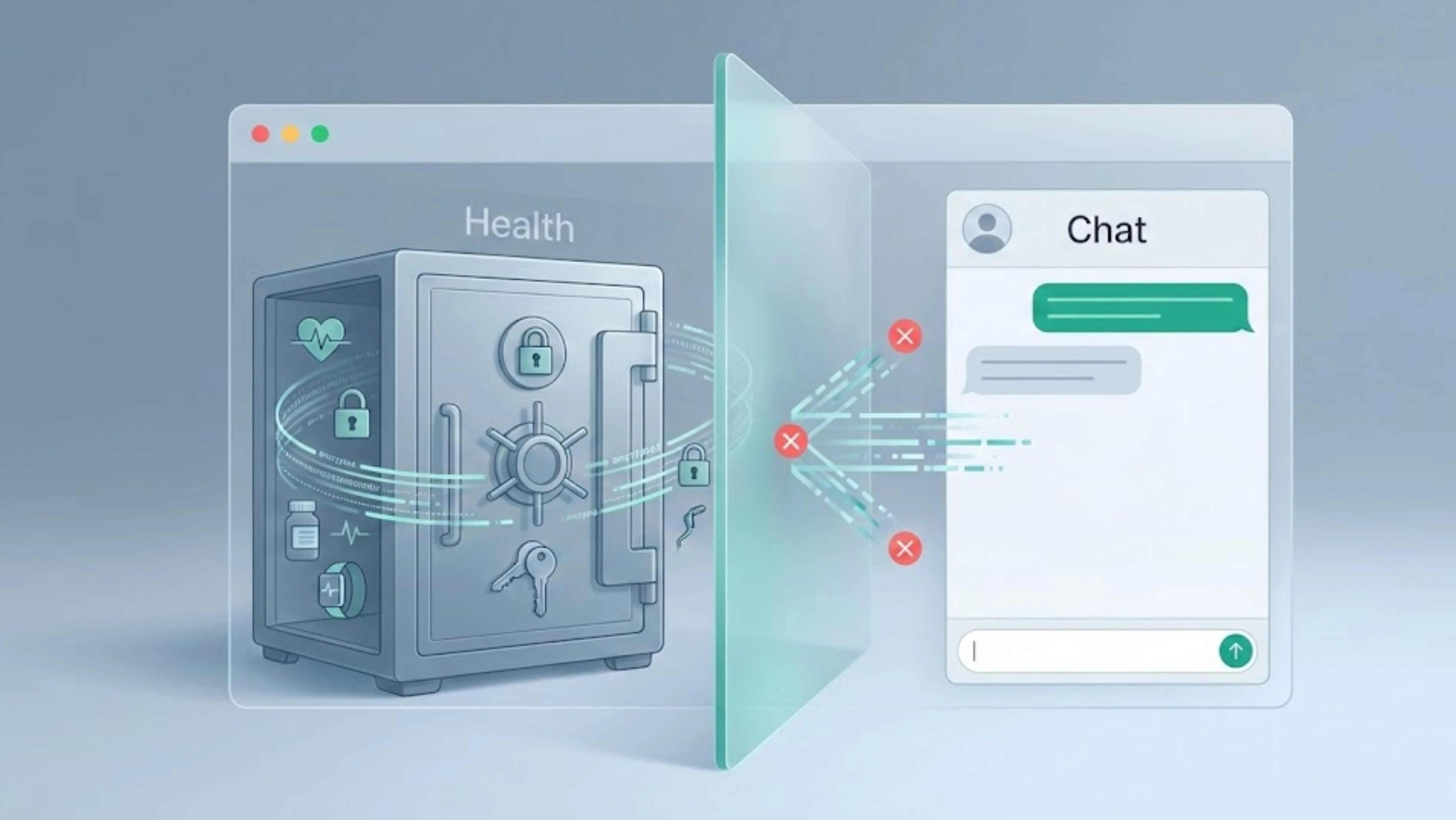

O que é: um “cofre” dentro do ChatGPT, com sandbox e isolamento específicos para conversas de saúde.

O grande ganho: o conteúdo do Health fica compartimentalizado e não alimenta treinamento dos modelos base da OpenAI.

A limitação: a empresa reforça que o recurso foi projetado para apoiar o cuidado médico, não para substituir diagnóstico ou tratamento profissional.

Silo de privacidade: como funciona o bloqueio

O desenho do ChatGPT Health parte de duas camadas: isolamento lógico (compartimentos separados) e criptografia “purpose-built” (construída para esse cenário). A consequência prática é direta: o que acontece no Health, fica no Health.

Há uma separação explícita entre “Health” e o restante do ChatGPT. As informações e memórias do Health não são usadas para contextualizar chats fora do Health, e o caminho inverso também é bloqueado: conversas fora do Health não podem acessar arquivos, conversas ou memórias criadas no ambiente protegido.

A experiência também inclui um mecanismo de direcionamento. Se o usuário tenta iniciar um diálogo de saúde no ChatGPT “regular”, o sistema pode sugerir a migração para o Health, justamente para que a conversa ocorra sob essas proteções adicionais.

Integrações e HealthBench

O Health oferece, de forma opcional, a possibilidade de conectar com segurança registros médicos e apps de bem-estar para respostas mais contextualizadas. Entre as integrações citadas estão Apple Health, Function, MyFitnessPal, Weight Watchers, AllTrails, Instacart e Peloton.

Essa integração, segundo a OpenAI, depende de permissão explícita do usuário, mesmo que um aplicativo já esteja conectado ao ChatGPT para conversas fora do Health. Além disso, os aplicativos incluídos no Health precisam cumprir requisitos de privacidade e segurança, incluindo coleta mínima de dados e uma revisão de segurança adicional para serem aceitos no ecossistema.

Para sustentar a narrativa de segurança e qualidade, a empresa afirma ter avaliado o modelo que “alimenta” o Health com base em padrões clínicos usando o HealthBench, benchmark apresentado em maio de 2025 com foco em segurança, clareza e escalonamento de cuidado. A ênfase está em tarefas como explicar resultados de exames em linguagem acessível, ajudar a preparar perguntas para consultas, interpretar dados de wearables e resumir instruções de cuidado.

O contexto urgente: por que agora?

O lançamento ocorre em um momento de pressão pública sobre respostas de IA em temas sensíveis. Uma investigação do The Guardian apontou que o Google AI Overviews teria fornecido informações de saúde falsas e enganosas, elevando a discussão sobre risco e responsabilização.

No mesmo período, a OpenAI e a Character.AI enfrentam processos que alegam que seus sistemas contribuíram para suicídio e delírios prejudiciais após usuários confiarem neles. Um caso reportado pelo SFGate descreve a morte de um jovem de 19 anos por overdose após confiar no ChatGPT para orientação médica, reforçando por contraste a mensagem de “suporte, não substituição” que a OpenAI repete no anúncio do Health.

Disponibilidade e quem ficou de fora

O ChatGPT Health está em rollout para usuários dos planos Free, Go, Plus e Pro. A OpenAI afirma que o recurso não estará disponível no Espaço Econômico Europeu (EEA), na Suíça e no Reino Unido.

A empresa não detalha outros recortes geográficos na mesma comunicação. Por isso, a única conclusão segura é a exclusão explícita dessas regiões citadas.