A segurança digital entrou em uma nova fase após pesquisadores do Google Threat Intelligence Group identificarem evidências do uso de inteligência artificial no desenvolvimento de um exploit zero-day voltado contra uma ferramenta de administração web. O caso representa um marco importante porque mostra que modelos de IA já estão sendo utilizados para acelerar ataques cibernéticos sofisticados.

Segundo o relatório do Google, os criminosos usaram ferramentas baseadas em modelos de linguagem para auxiliar na construção do código malicioso. A descoberta chamou atenção não apenas pelo ataque em si, mas pelos rastros deixados pela IA durante o processo de desenvolvimento do exploit.

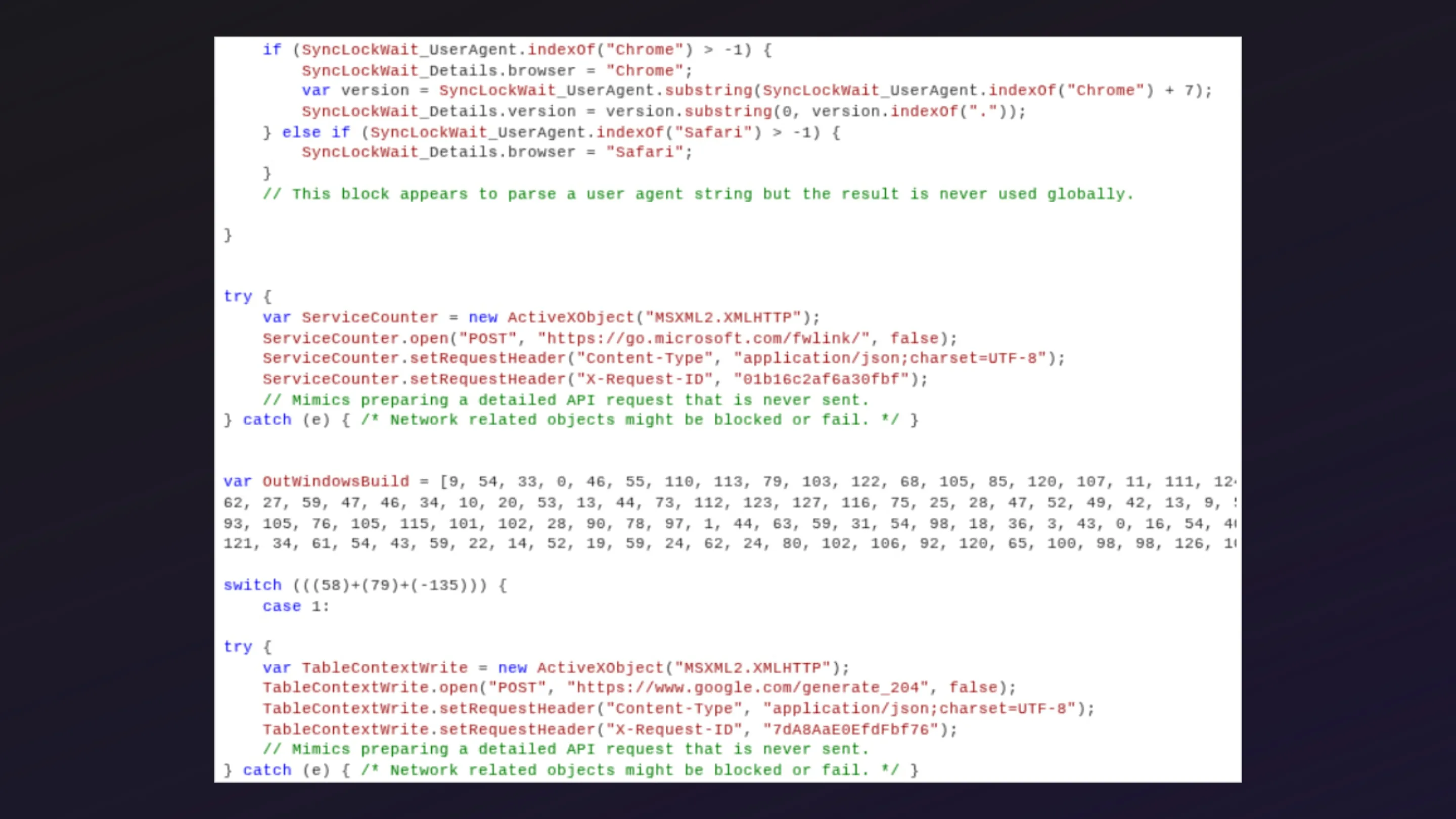

Os pesquisadores encontraram padrões típicos de código produzido por modelos generativos, incluindo comentários excessivamente detalhados, organização semântica altamente estruturada e até erros característicos de “alucinação” de IA. O episódio reforça um cenário cada vez mais preocupante para empresas, administradores de sistemas e profissionais de TI: a inteligência artificial começa a transformar profundamente o ecossistema do cibercrime.

Como o Google identificou o uso de IA no exploit zero-day

O relatório aponta diversos indícios técnicos que sugerem o uso de inteligência artificial no desenvolvimento da vulnerabilidade explorada.

O primeiro sinal estava nas docstrings, comentários usados para explicar funções dentro do código. Os trechos encontrados apresentavam um estilo extremamente didático, detalhado e organizado, comportamento frequentemente associado a códigos produzidos por modelos de linguagem avançados.

Outro detalhe importante foi a presença de uma classificação CVSS inconsistente. O exploit continha uma pontuação de gravidade incompatível com a vulnerabilidade analisada, algo que os pesquisadores relacionaram ao fenômeno de “alucinação” observado em sistemas de IA generativa.

Além disso, o código possuía uma estrutura semântica muito organizada, com funções modulares e padronização incomum em campanhas criminosas desenvolvidas rapidamente.

Os especialistas acreditam que os atacantes utilizaram IA como ferramenta de apoio, acelerando a criação do exploit e reduzindo o esforço necessário para encontrar falhas exploráveis.

Imagem: Google

Por que falhas de lógica se tornaram alvo ideal para IA

Tradicionalmente, muitos ataques zero-day exploravam corrupção de memória, buffer overflow ou outras falhas técnicas complexas de baixo nível.

Neste caso, porém, o exploit explorava uma falha de lógica na autenticação da aplicação web. Esse tipo de vulnerabilidade depende mais da compreensão contextual do funcionamento do sistema do que de exploração bruta de memória.

É justamente nesse cenário que modelos de IA conseguem se destacar.

Ferramentas baseadas em LLMs possuem capacidade avançada para interpretar fluxos de autenticação, permissões e relações entre componentes da aplicação. Isso permite identificar inconsistências semânticas difíceis de detectar com scanners tradicionais.

Entre as vantagens desse modelo de ataque estão:

- Criação mais rápida de exploits

- Facilidade para adaptar ataques

- Automatização parcial do desenvolvimento

- Menor necessidade de conhecimento avançado em baixo nível

- Escalabilidade maior para campanhas criminosas

Especialistas alertam que vulnerabilidades de lógica tendem a ganhar protagonismo nos próximos anos justamente por serem mais compatíveis com a capacidade analítica dos modelos generativos.

O objetivo do ataque: contornar a autenticação em dois fatores

O exploit analisado pelo Google tinha um objetivo extremamente perigoso: permitir o bypass de mecanismos de autenticação de dois fatores (2FA).

Na prática, os criminosos tentavam contornar camadas extras de proteção usadas em painéis administrativos web. Caso a exploração fosse bem-sucedida, invasores poderiam assumir controle de servidores e ambientes corporativos críticos.

Ferramentas de administração web normalmente possuem acesso privilegiado a sistemas internos. Isso significa que uma invasão desse tipo poderia abrir caminho para:

- Controle remoto de servidores

- Roubo de dados corporativos

- Instalação de malware persistente

- Criação de usuários administrativos ocultos

- Movimentação lateral dentro da rede

Segundo o relatório, o ataque explorava inconsistências na sequência de validação da autenticação, permitindo ignorar determinadas etapas de verificação.

O mais preocupante é que a IA aparentemente ajudou os criminosos a identificar exatamente onde a lógica da aplicação poderia ser manipulada sem disparar alertas convencionais de segurança.

A expansão do cibercrime impulsionado por inteligência artificial

O caso faz parte de um cenário mais amplo observado pelo Google: o crescimento do uso de IA em operações ofensivas conduzidas por grupos criminosos e organizações APT.

O relatório cita atividades envolvendo:

- Phishing altamente personalizado

- Clonagem de voz para engenharia social

- Geração automatizada de malware

- Tradução dinâmica de campanhas globais

- Automatização de reconhecimento de alvos

Entre os exemplos mencionados aparecem ameaças como PromptSpy e CANFAIL, associadas ao uso avançado de inteligência artificial em operações maliciosas.

A grande preocupação da indústria é que a IA reduz drasticamente a barreira de entrada para ataques sofisticados. Ferramentas que antes exigiam equipes altamente especializadas agora podem ser parcialmente automatizadas com auxílio de modelos generativos.

Além disso, a velocidade de desenvolvimento aumenta significativamente. Um exploit que levaria semanas para ser produzido pode ser estruturado em muito menos tempo com suporte de IA.

O futuro da segurança digital diante da IA ofensiva

A descoberta do Google deixa claro que a inteligência artificial já começou a alterar o equilíbrio entre ataque e defesa no ambiente digital.

Embora especialistas ressaltem que humanos ainda são responsáveis pelas decisões estratégicas, a IA passa a desempenhar papel cada vez mais relevante na automação de exploits, análise de sistemas e identificação de vulnerabilidades.

Isso exige uma mudança urgente nas estratégias defensivas.

Ferramentas tradicionais baseadas apenas em assinaturas e padrões conhecidos podem não ser suficientes para lidar com ameaças adaptativas capazes de explorar falhas semânticas complexas.

A tendência é que empresas invistam cada vez mais em soluções de defesa baseadas em IA, capazes de detectar comportamentos anômalos em tempo real e antecipar cadeias de exploração antes que ataques sejam concluídos.

O relatório do Google funciona como um alerta importante para toda a indústria: a inteligência artificial já faz parte do cenário ofensivo moderno, e a próxima geração de ameaças digitais tende a ser muito mais rápida, automatizada e difícil de conter.