A busca por inteligência artificial local, com mais privacidade e menos dependência da nuvem, cresce rapidamente entre usuários de Mac. Nesse contexto, o suporte ao MLX no Ollama 0.19 em Macs com Apple Silicon surge como uma evolução importante para quem quer rodar modelos de linguagem diretamente no dispositivo.

A nova versão do Ollama passa a integrar o Apple MLX, permitindo um uso mais eficiente do hardware da Apple. Na prática, isso significa melhor desempenho, menor latência e maior aproveitamento dos recursos do sistema.

Mais do que uma atualização técnica, essa mudança reforça o avanço da IA local em Macs com Apple Silicon, tornando o uso de modelos avançados mais acessível e eficiente.

O que é o Ollama com MLX em Macs com Apple Silicon

O Ollama é uma ferramenta que facilita a execução de modelos de linguagem (LLMs) localmente. Ele permite baixar, configurar e rodar modelos diretamente no Mac, com comandos simples e sem necessidade de infraestrutura complexa.

Com a chegada do MLX ao Ollama em Macs com Apple Silicon, o processamento desses modelos se torna mais eficiente, aproveitando melhor CPU, GPU e outros aceleradores presentes nos chips da Apple.

Isso resulta em:

- Mais velocidade na geração de respostas

- Menor consumo de energia

- Maior estabilidade ao rodar modelos maiores

O papel do framework MLX da Apple

O MLX é um framework desenvolvido pela Apple com foco em desempenho otimizado para Apple Silicon. Ele foi projetado para tirar proveito da arquitetura dos chips da empresa, integrando diferentes unidades de processamento.

Entre seus principais benefícios estão:

- Execução eficiente em CPU e GPU

- Uso inteligente do Neural Engine

- Melhor gerenciamento de memória

Quando integrado ao Ollama, o MLX permite que os modelos rodem com menos gargalos e maior fluidez.

Memória unificada: O segredo da performance

Um dos pilares do desempenho dos Macs modernos é a memória unificada, que permite que CPU e GPU compartilhem o mesmo espaço de memória.

Isso elimina a necessidade de transferências constantes de dados entre diferentes áreas do sistema, o que é especialmente importante para modelos de IA.

Na prática, isso proporciona:

- Carregamento mais rápido de modelos

- Execução mais eficiente

- Menor latência nas respostas

Com o suporte ao MLX, o Ollama passa a explorar melhor essa característica dos chips Apple.

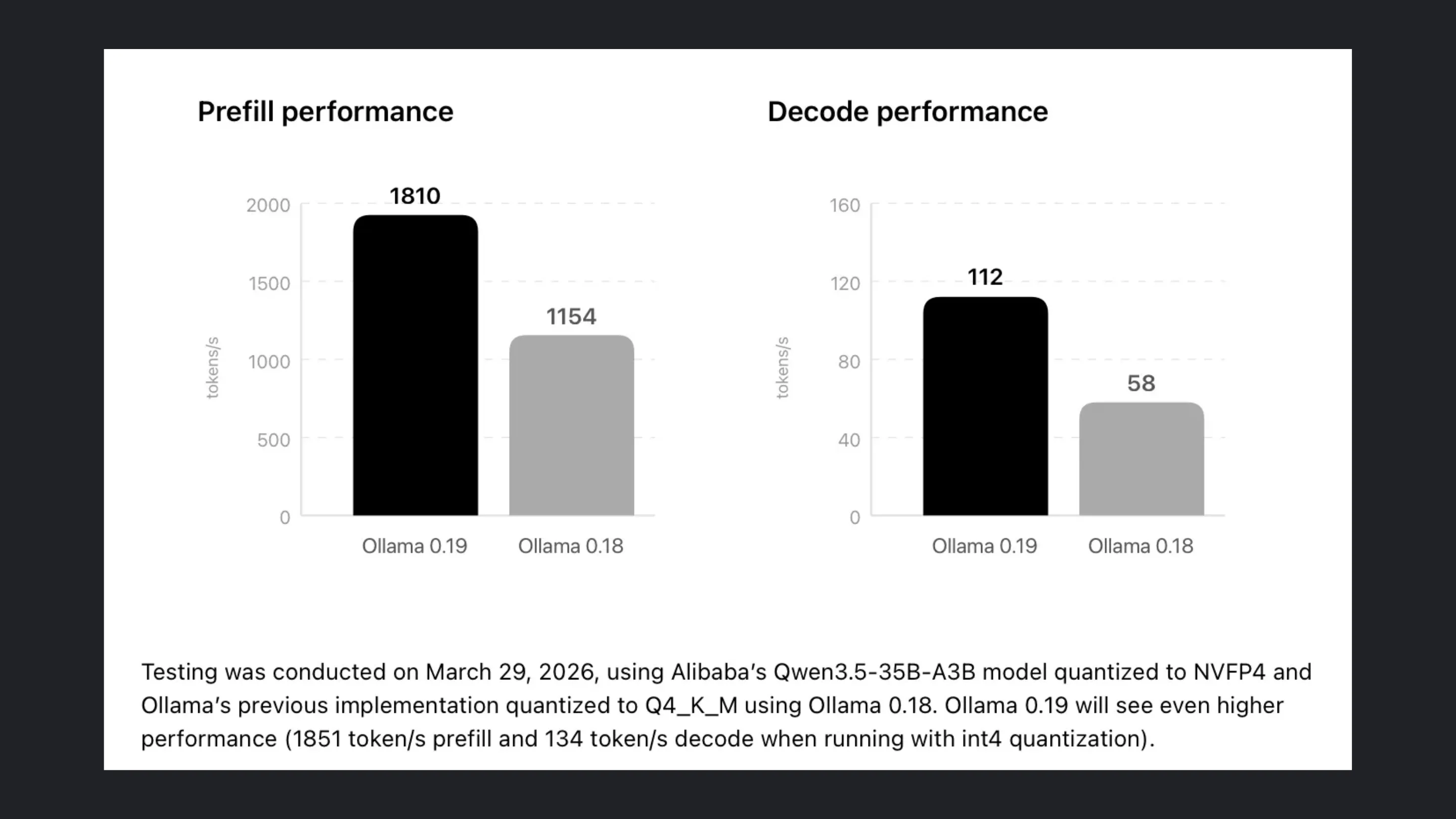

Ganhos reais de velocidade nos Macs com Apple Silicon

A integração com o MLX traz melhorias perceptíveis no uso diário, principalmente em métricas como:

- Tempo até o primeiro token (TTFT)

- Quantidade de tokens por segundo

Nos chips mais recentes, como M5, M5 Pro e M5 Max, os ganhos são ainda mais evidentes, graças à evolução dos componentes de processamento e dos aceleradores neurais.

Mesmo em Macs com chips mais antigos, como M1 e M2, já é possível perceber:

- Respostas mais rápidas

- Execução mais estável

- Melhor aproveitamento do hardware

Esses avanços tornam o uso de IA local mais prático e eficiente no dia a dia.

Requisitos de hardware e recomendações

O desempenho do Ollama com MLX depende diretamente da configuração do Mac.

Para uso básico, é possível rodar modelos menores com:

- 8 GB ou 16 GB de RAM

No entanto, para uma experiência mais fluida, especialmente com modelos maiores, o ideal é:

- 32 GB de memória unificada ou mais

Entre os modelos que podem ser utilizados localmente estão:

- Llama

- Claude Code

- OpenClaw

A escolha depende do tipo de uso, como desenvolvimento, testes ou automação.

O futuro da IA local nos Macs da Apple

A integração entre Ollama e MLX reforça uma tendência clara: a execução de IA diretamente no dispositivo.

Isso traz vantagens importantes como:

- Mais privacidade

- Menor dependência da nuvem

- Maior controle sobre os dados

Para usuários de Mac, especialmente aqueles com Apple Silicon, essa evolução amplia as possibilidades de uso da inteligência artificial no dia a dia.