O avanço acelerado da inteligência artificial trouxe ganhos impressionantes em produtividade e automação, mas também levantou um alerta importante: o alto consumo de energia e água necessário para sustentar modelos cada vez maiores. Data centers modernos já competem com cidades inteiras em demanda energética, e isso coloca pressão tanto ambiental quanto econômica sobre empresas de tecnologia.

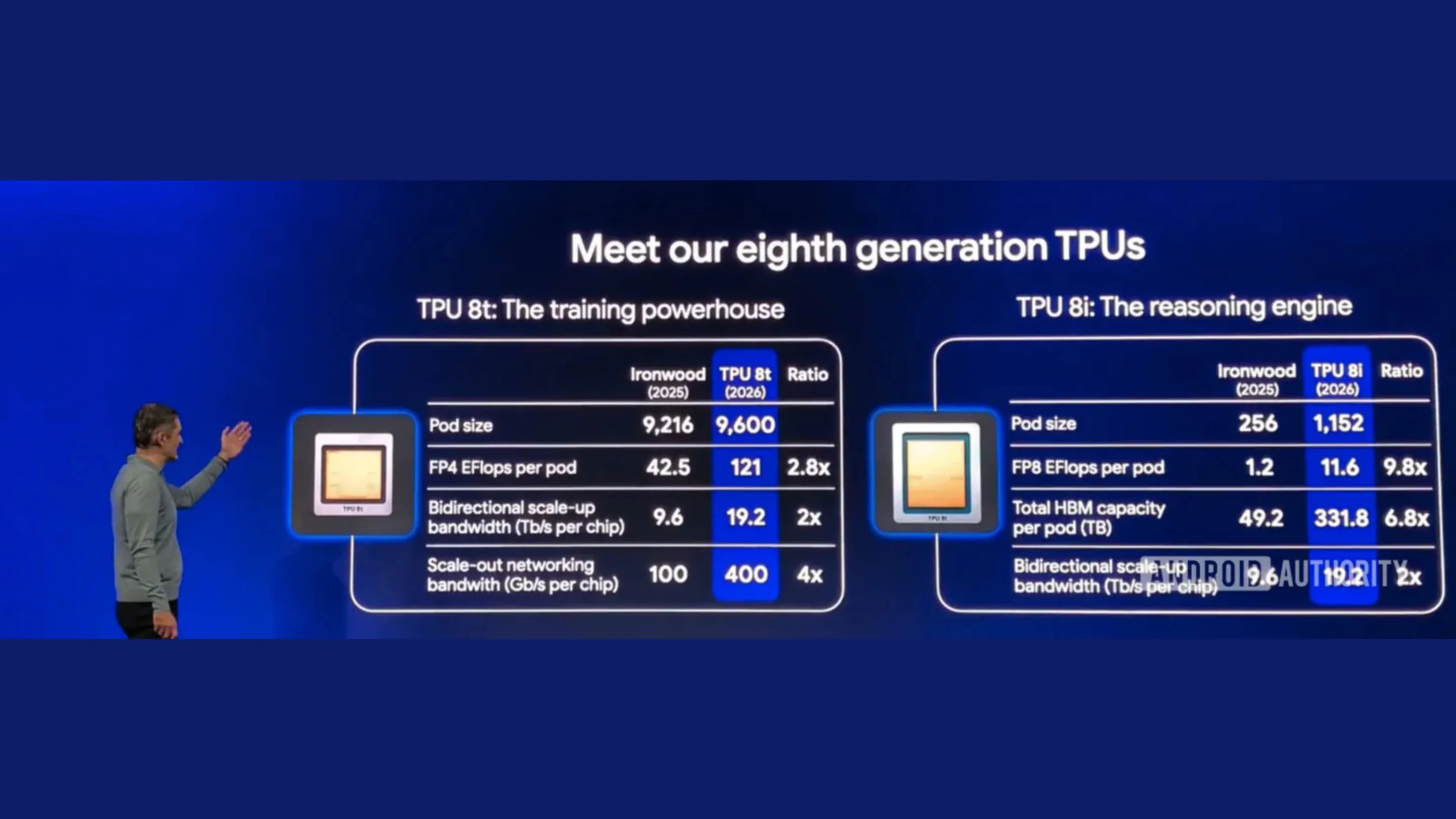

É nesse cenário que o Google apresenta suas novas TPUs do Google de 8ª geração, durante o evento Google Cloud Next 2026. Com os modelos TPU 8t e TPU 8i, a empresa aposta em uma abordagem mais eficiente ao separar o hardware dedicado ao treinamento daquele voltado para inferência, especialmente em serviços como o Gemini.

O objetivo é claro: aumentar o desempenho enquanto reduz custos operacionais e impacto ambiental. Mas será que isso também significa economia para o usuário final? É o que vamos analisar.

O que são as novas TPUs 8t e 8i

As novas TPUs do Google representam uma evolução estratégica no design de hardware para IA. Em vez de criar um chip genérico para todas as tarefas, o Google decidiu dividir funções críticas em dois tipos distintos.

A TPU 8t é voltada para treinamento, enquanto a TPU 8i foi otimizada para inferência. Essa separação permite maior eficiência, já que cada chip é projetado especificamente para sua carga de trabalho.

Treinamento: Onde os modelos aprendem

O treinamento de modelos de IA é uma das tarefas mais intensivas em computação. É aqui que redes neurais aprendem padrões por meio de processos como retropropagação de erros, exigindo enorme capacidade de processamento paralelo.

A TPU 8t foca exatamente nesse ponto. Ela entrega alto desempenho bruto para lidar com grandes volumes de dados e cálculos complexos. Esse tipo de hardware é essencial para treinar modelos como o Gemini, que dependem de bilhões ou até trilhões de parâmetros.

Na prática, isso significa maior velocidade no desenvolvimento de novas IAs, mas com alto consumo energético, algo que o Google tenta compensar com eficiência arquitetural.

Inferência: A IA em ação no seu dia a dia

Se o treinamento é onde a IA aprende, a inferência é onde ela entra em ação. Cada vez que você usa um chatbot, traduz um texto ou gera uma imagem, está acionando esse processo.

A TPU 8i foi criada para tornar essa etapa mais eficiente. Como a inferência exige menos poder computacional que o treinamento, faz sentido usar um hardware mais leve e otimizado.

O resultado é uma melhoria significativa na Eficiência do Google Cloud, permitindo que serviços como o Gemini sejam mais rápidos e consumam menos energia. Isso é crucial, já que a maior parte das interações com IA acontece justamente nessa fase.

O impacto ambiental e a promessa de sustentabilidade

Um dos principais argumentos do Google ao lançar suas novas TPUs do Google é a redução do impacto ambiental. Data centers são conhecidos por consumir grandes quantidades de energia e água, especialmente para resfriamento.

Com a separação entre TPU 8t e Nova TPU 8i, a empresa consegue otimizar o uso de recursos. Chips de inferência mais eficientes significam menos energia por requisição, algo que escala de forma significativa quando aplicado a bilhões de interações diárias.

Além disso, a redução do calor gerado também diminui a necessidade de sistemas intensivos de resfriamento, o que pode impactar diretamente o consumo de água.

Apesar dessas melhorias, é importante manter um olhar crítico. O crescimento do uso de IA pode compensar esses ganhos de eficiência, resultando em consumo total ainda elevado. Ou seja, eficiência não significa necessariamente redução absoluta.

A questão econômica: A conta vai baixar para o usuário?

Com maior eficiência operacional, seria natural esperar uma redução nos custos para usuários e empresas que utilizam serviços de IA. No entanto, o Google não fez promessas claras nesse sentido.

A adoção das novas TPUs do Google certamente reduz custos internos, especialmente em larga escala. Isso beneficia diretamente a infraestrutura do Hardware de IA do Google e melhora margens operacionais.

Por outro lado, preços de serviços em nuvem e APIs de IA dependem de diversos fatores, incluindo estratégia de mercado e concorrência. Até o momento, não há garantias de que essa economia será repassada.

Para desenvolvedores e empresas que utilizam o Google Cloud, a expectativa é de melhor desempenho pelo mesmo custo, e não necessariamente preços mais baixos.

Conclusão: O futuro da infraestrutura de IA

O lançamento das TPUs do Google de 8ª geração marca um passo importante na evolução da infraestrutura de inteligência artificial. A separação entre treinamento e inferência mostra que o futuro da IA passa por especialização e eficiência.

Com a TPU 8t e a TPU 8i, o Google busca equilibrar desempenho, custo e sustentabilidade, três pilares fundamentais para a expansão contínua da IA. No entanto, desafios permanecem, especialmente no que diz respeito ao impacto ambiental total e à transparência nos custos para o usuário final.

A tendência é clara: hardware cada vez mais especializado será essencial para tornar a IA viável em escala global.