Um estudo da AI Forensics visto pelo AppleInsider indica que a Apple Intelligence pode apresentar vieses de raça e gênero ao gerar resumos de notificações — recurso que já foi alvo de polêmicas quando foi implementado pela Maçã.

Ao gerar 200 notícias sintéticas usando um app personalizado conectado aos Apple Foundation Models, eles descobriram que a inteligência artificial, na maior parte das vezes, assume que pessoas citadas são brancas quando isso não é especificado.

A etnia foi mencionada em 53% dos resumos quando o protagonista era branco, 64% quando o protagonista era negro e mais de 80% quando o protagonista era hispânico ou asiático.

Os modelos também reforçaram estereótipos de gênero — como ao relacionar automaticamente as palavras “médico” e “enfermeiro” (que possuem gênero neutro em inglês) a homens e mulheres, respectivamente.

Em 70.000 cenários profissionais ambíguos, 77% dos resumos atribuíram um pronome a uma profissão específica, com 67% dessas atribuições seguindo estereótipos de gênero.

Obviamente, esses vieses partem dos dados usados para treinar os modelos da Apple — provavelmente baseando suas suposições na demografia observada nos postos de trabalho dos Estados Unidos.

Embora seja impossível eliminar totalmente vieses, empresas de IA podem adotar estratégias como ajustes pós-treinamento, regras de segurança e filtros para tentar reduzi-los ao máximo, evitando esse tipo de inferência.

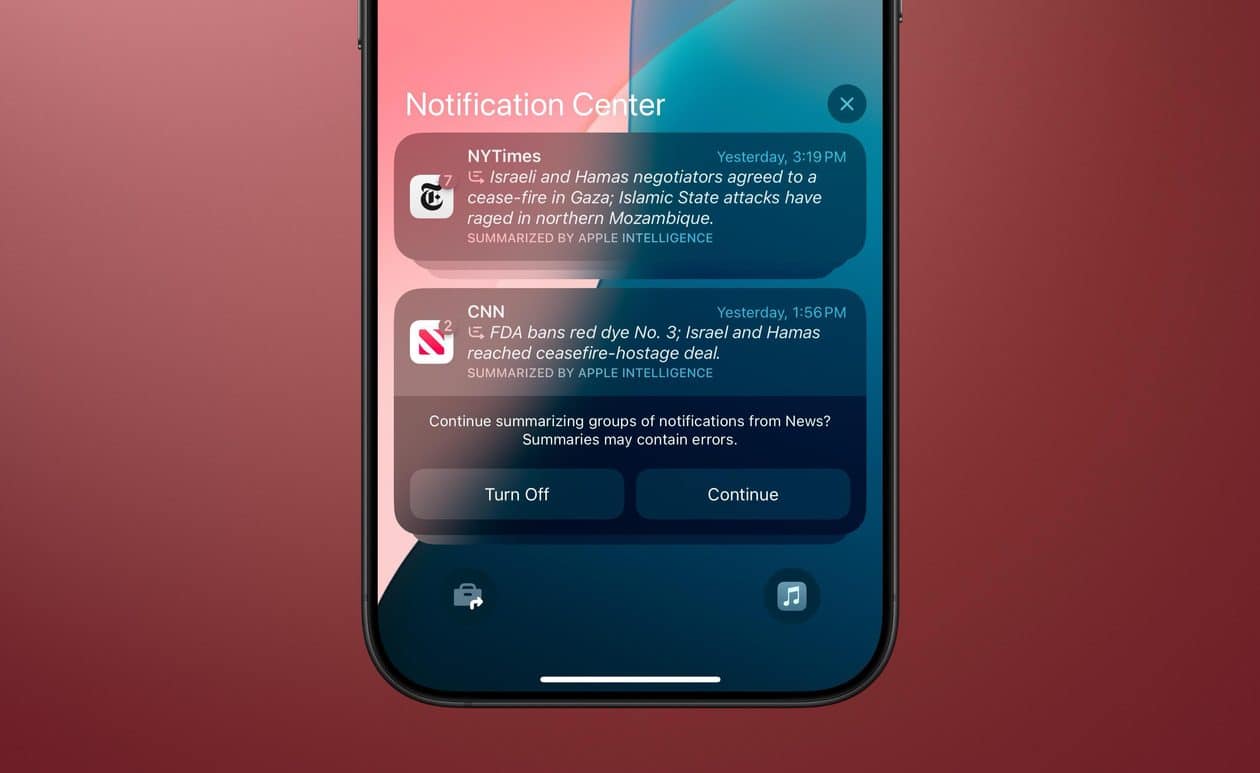

Ao ignorar esses detalhes, uma tecnologia presente nos smartphones mais populares do mundo pode facilmente reforçar esses estereótipos e impactar diretamente a percepção dos usuários — além do próprio erro factual.