Um novo estudo publicado pela Apple descreve uma nova abordagem de treinar modelos de inteligência artificial voltados à geração de interfaces de usuário, que podem se basear em feedback de designers profissionais para entregar resultados de maior qualidade.

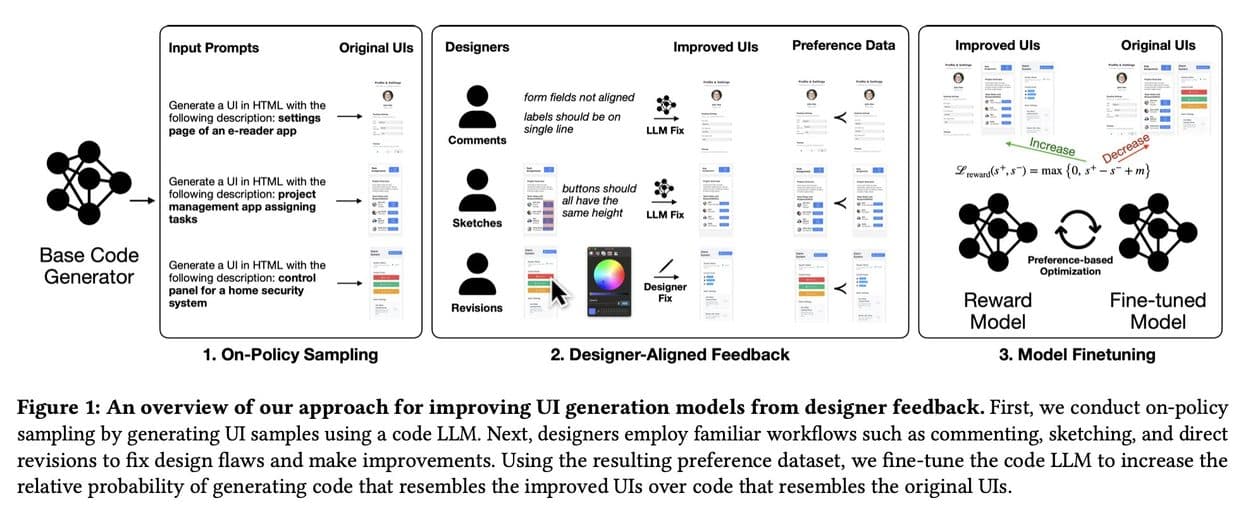

Intitulada “Improving User Interface Generation Models from Designer Feedback” (algo como “Aprimorando Modelos de Geração de Interface do Usuário a partir do Feedback do Designer”), essa pesquisa explica que o método mais tradicional, chamado Reinforcement Learning from Human Feedback (Aprendizagem por Reforço a partir do Feedback Humano, ou RLHF), não é o melhor para essa tarefa, pois ele não está alinhado com o workflow de profissionais do mercado.

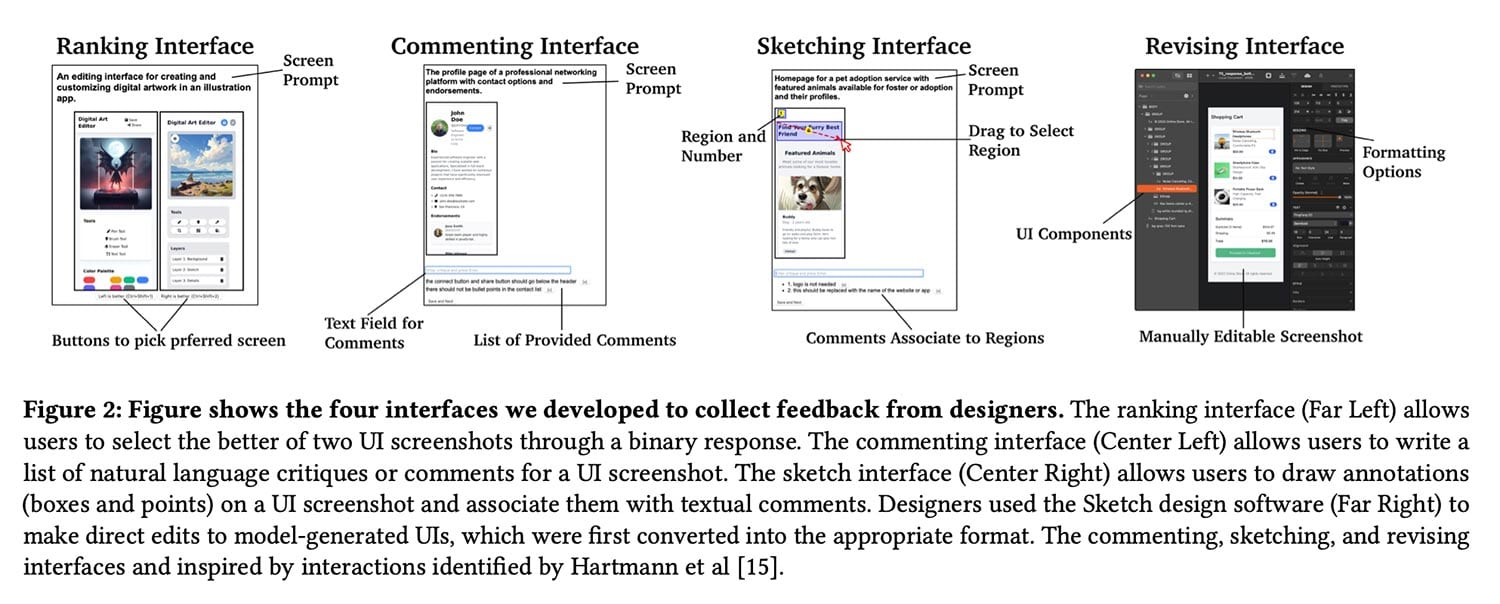

Em contrapartida, a Maçã propõe um método que coloca designers para aprimorar o modelo de IA por meio de comentários, esboços e até mesmo edições práticas — elementos que são convertidos posteriormente em dados, os quais possibilitam um sistema de recompensa com base em melhorias concretas.

No seu estudo, a Apple recrutou 21 designers com os mais variados níveis de experiência, os quais forneceram mais de 1.460 anotações na forma de capturas de tela e descrições em linguagem natural para que o modelo pudesse interpretar e gerar uma pontuação numérica (recompensa). Esse número, ainda segundo a empresa, é calibrado de modo que designs de maior qualidade resultem em pontuações maiores.

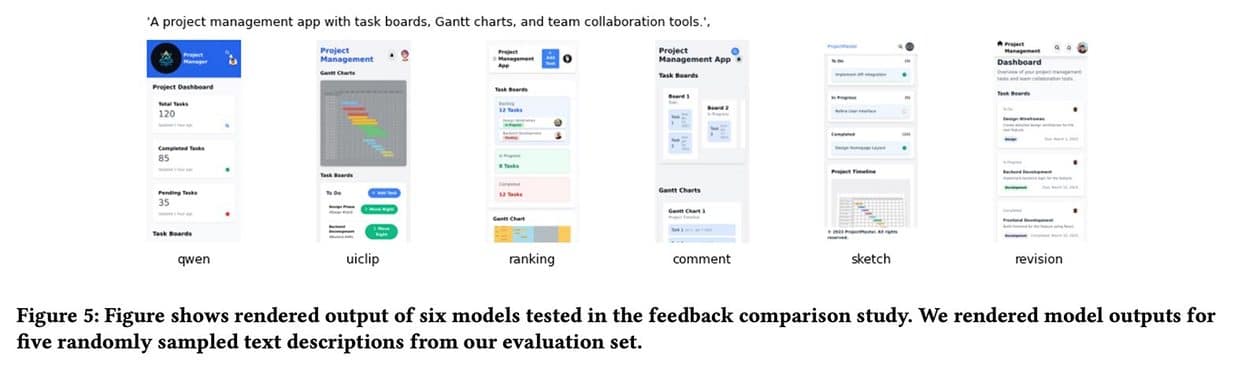

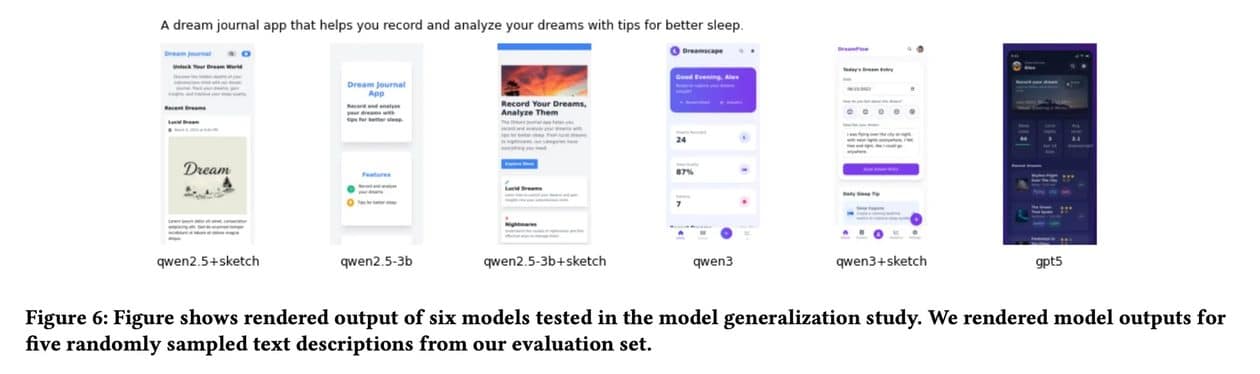

O modelo de IA escolhido pela Maçã para o teste foi o Qwen2.5-Coder, sendo que versões mais recentes dele também passaram pelo mesmo sistema de recompensas treinado por designers para averiguar quão bem o novo método se sai quando aplicado em situações mais amplas.

Como esperado, modelos treinados com o feedback de profissionais entregaram interfaces de maior qualidade do que os modelos originais, que se basearam apenas em dados convencionais de classificação ou avaliação — entre os quais temos o GPT-5, um dos modelos mais recentes e avançados da OpenAI. Esses resultados também foram alcançados com apenas 181 anotações de designers, o que indica que interfaces ainda melhores poderiam ser entregues caso todas as 1.460 anotações fossem empregadas no treinamento.

Nossos resultados mostram que o ajuste fino com nosso modelo de recompensa baseado em esboços levou consistentemente a melhorias nas capacidades de geração de interface do usuário para todas as linhas de base testadas, sugerindo generalização. Também mostramos que uma pequena quantidade de feedback especializado de alta qualidade pode permitir que modelos menores superem LLMs proprietários maiores na geração de interface do usuário.

Há, no entanto, alguns desafios, como fazer designers e pesquisadores entrarem em um consenso sobre a qualidade das interfaces geradas quando convocados a escolher apenas uma entre duas opções, já que esse tipo de avaliação implica em um alto nível de subjetividade, além de considerar abordagens completamente diferentes — detalhe que fez ambas as partes concordarem apenas 49,2% do tempo.

Esse número, no entanto, foi bem maior quando os designers forneceram feedback na forma de rascunhos ou de edições diretas na UI gerada, ficando em 63,6% no primeiro caso e em 76,1% no segundo.

Caso você queira se debruçar sobre os aspectos técnicos desse estudo, basta acessar esse link.

via 9to5Mac